Peter Fleissner und Gregor Fleissner

Vorbemerkung

Spätestens seit dem Bau der ersten elektronischen

Rechner fasziniert die Frage, ob Maschinen denken können.

Die Diskussion darüber war und ist auch heute noch von mannigfaltigen

Veränderungen der Interpretation der Begriffe "Denken"

oder "Intelligenz" begleitet. Von 1950 bis in die frühen

80er Jahre setzte der Turing-Test eine praktisch nachprüfbare

Grenze, ob eine Maschine menschliches Intelligenzniveau erreicht

hat. Im Sinne behavioristischer Theorie wurde danach eine Maschine

"intelligent" genannt, wenn eine Person (ein Nichtexperte),

die über ein Terminal kommuniziert, durch Befragung nicht

mehr feststellen kann, ob sich hinter dem Terminal ein Mensch

oder ein Computer verbirgt (Turing 1950). Es ist klar, daß

der bestandene Test nicht heißt, daß Maschinen im

menschlichen Sinn denken können, sondern nur, daß sie

ein Verhalten zeigen, das sich auf der Ebene textueller Interaktion

von menschlichem Verhalten kaum mehr unterscheiden läßt

(ein mit einem Schraubenzieher bewaffneter Techniker würde

sich durch eine noch so perfekte Imitation menschlicher Schreibart

nicht von einer Maschine täuschen lassen - er würde

einfach nachsehen, was sich hinter dem Schirm befindet).

Im Jahre 1982 wurde der Turing-Test und seine

spezielle Auffassung von maschineller Intelligenz durch den Philosophen

John Searle herausgefordert (Searle 1982, 1990). In einem Gedankenexperiment,

das als das "Chinesische Zimmer" in die Geistesgeschichte

einging, beschrieb Searle ein System, das den Turing-Test in bezug

auf das Verständnis der chinesischen Sprache bestehen würde.

Searle selbst befindet sich in seinem Gedankenexperiment in einem

Raum, der mit Kärtchen auf chinesisch und mit Indexkarten

gefüllt ist, auf denen Instruktionen in englisch geschrieben

sind. Durch eine Öffnung in der Wand wird Searle, der uns

versichert, daß er keine Ahnung von chinesisch hat, ein

chinesischer Text durchgereicht, und danach Zettel, die - wieder

auf chinesisch - Fragen zu diesem Text enthalten. Im Lauf der

Zeit entwickelt Searle - eingesperrt in das chinesische Zimmer

- genügend Geschick, aufgrund der Instruktionen in englisch

diejenigen Kärtchen herauszureichen, die richtige Antworten

auf chinesisch auf die auf chinesisch gestellten Fragen enthalten.

Heißt die Tatsache, daß Searle im Experiment auf chinesische

Fragen die richtigen Antworten in chinesisch gibt, daß er

selbst chinesisch versteht? Obwohl der Turing-Test als bestanden

angesehen werden muß, meint Searle, daß er selbst

nach wie vor kein Wort chinesisch verstünde, und weiters

verallgemeinert er: "... and neither does any other digital

computer because all the computer has is what I have: a formal

program that attaches no meaning, interpretation, or content to

any of the symbols" (Searle 1982).

Searle beantwortet mit seinem Gedankenexperiment

die Frage nach der Denkfähigkeit von Maschinen durch eine

Engführung des Begriffs Intelligenz. Durch seine Wahl der

Fremdsprachenkenntnisse als speziellem Beispiel glaubt er, die

inneren Fähigkeiten (des Verständnisses von Sprache)

von der Anwendung dieser Fähigkeiten (korrekte Beantwortung

von Fragen) abtrennen zu können (Turkle 1995: 87). Sprachverständnis

und das Beantworten von Fragen können (so interpretieren

wir Searle) in seiner Sicht als voneinander unabhängige Aktivitäten

aufgefaßt werden. Damit weist er der Maschine zu, was der

Maschine, und dem Menschen, was des Menschen ist. Die Ordnung

der Dinge ist wiederhergestellt. Jedes hat seinen ihm zukommenden

Bereich, und der Mensch wird beruhigenderweise durch die Maschine

nicht entthront.

Obwohl wir die Schlußfolgerung von Searle

(die man vielleicht respektlos so ausdrücken kann, daß

ein Computer eben kein Mensch ist) klarerweise teilen, sehen wir

in seinem Gedankenexperiment zwei - einander entgegengesetzte

- Fehleinschätzungen: Die erste besteht in einer eher reduzierten

Sicht des Problems der Fragenbeantwortung, wobei er den Computer

und seine Möglichkeiten überschätzt. Wir

wissen heute, daß es praktisch nicht möglich ist, ein

vollständiges Set von Instruktionen für die Beantwortung

von Fragen in befriedigender Weise anzugeben, immer kann uns eine

Metafrage aus dem programmierten Korsett werfen. Dem entsprechend

sind nach wie vor die Ergebnisse von Übersetzungsprogrammen

ohne menschliche Bearbeitung nur eingeschränkt brauchbar,

was nicht heißt, daß sie in speziellen Fällen

und Disziplinen nicht eine wichtige Unterstützung menschlicher

Arbeit darstellen können. Auch die Grenzen der Anwendung

von Expertensystemen, etwa bei Vorhandensein von "tacit knowledge",

weisen auf diese Schwierigkeiten hin.

Andererseits zeigt sich Searle zu pessimistisch

und unterschätzt die Möglichkeiten des Computers,

"to attach meaning, interpretation, or content to any

of the symbols". Der vorliegende Beitrag entfaltet ein

Gegenbeispiel, das zeigen soll, daß in bestimmten Settings

auf dem Computer durchaus so etwas wie "Bedeutung" und

"Pragmatik" entstehen kann, ja, daß die von Searle

erwähnten "Instruktionen" durchaus nicht explizit

vom Programm vorgegeben sein müssen, sondern daß sie

sich erst im Lauf eines besonderen Interaktions- und Kommunikationsprozesses

herausbilden können. Anders als bei menschlicher Kommunikation

- und das ist die Einschränkung und der wesentliche Unterschied

- ist allerdings die Menge der Symbole, die den virtuellen Subjekten

des Programms insgesamt zur Verfügung steht, vom Programm

vorgegeben. Welche allerdings davon ausgewählt werden, und

welche Bedeutung sie erhalten, ist nicht voraussagbar.

Bei menschlicher Informationsverarbeitung ist

die Menge der Symbole nur in reduzierten Fällen vollständig

angebbar. Das Neue, das per definitionem nicht vorherzusehen ist,

kann daher auch nicht als Element einer Menge angegeben werden,

wie es die formale mathematisch-logische Behandlung erfordern

würde.

Zur Konstruktion eines Gegenbeispiels zu Searles

Auffassung werden anhand dieses Computerprogramms bestimmte Aspekte

von Selbstorganisation simuliert, die - wie wir meinen - dadurch

besser verstanden und präzisiert werden können, insbesondere

das Zusammenspiel von Vorgängen zwischen physischer und symbolischer

Welt (Pragmatik) sowie die Entstehung von Semantik durch diese

Interaktion. Das Modell wurde von den Paradigmata der "Körperbasierten

Artificial Intelligence", der "Emergent AI" (Turkle

1994: 125-148) und dem Setting der Freudschen Psychoanalyse inspiriert

. Zur besseren Einordnung des hier beschriebenen Verfahrens wird

das Modell mit der Lernmatrix von Steinbuch verglichen.

Das Szenario

Wir treffen einige allgemeine Voraussetzungen,

die darstellen sollen, von welchem Blickwinkel aus das Modell

aufgebaut wurde. Wir unterscheiden eine physische Welt, Welt A,

die durch physikalische Gesetze vollständig beschrieben werden

kann, von einer informatischen Welt, Welt B.

Jede Ursache besitzt in Welt A eine ihr eindeutig

zugeordnete Wirkung. Diese Welt ist die (wie wir heute wissen,

eingeschränkte Sicht der) Welt der klassischen Mechanik,

actio est reactio.

Die zweite Welt, Welt B, zunächst streng

von der ersten geschieden, ist die Welt der Information. Hier

ist der Gegenpol zur Eindeutigkeit gegeben, actio non est reactio.

Die Ursache erzeugt zwar eine Wirkung, aber welche aus einer Menge

möglicher Wirkungen das sein wird, ist nicht vorhersehbar.

Die Wirkung besitzt also gegenüber der Ursache bestimmte

Freiheiten, sie ist mehrdeutig. Die Ursache beruht zwar - wie

in Welt A - auf einer physischen Basis, diese ist in unserem Zusammenhang

aber irrelevant. Sie hat hier ausschließlich informativen,

symbolischen Charakter und führt als Wirkung zu weiteren

Symbolen bzw. Handlungen.

Im vorliegenden Computerprogramm werden beide

Welten simuliert und miteinander in Beziehung gesetzt, um eine

bestimmte Aufgabe in Welt A unter Mitwirkung von Welt B zu lösen.

Dabei wird von einem idealisierten Szenario ausgegangen, das kurz

beschrieben werden soll:

In Welt A existieren drei Hauptelemente: die

"Barriere", ein "Springer" und ein "Sprecher".

Springer und Sprecher erhalten ihre Namen nach der ihnen zugeordneten

Hauptaktivität. Die Barriere, ein Hindernis, dessen Breite

zufällig wechselt, repräsentiert die Physis, die "Natur".

Die Breite des Hindernisses nimmt zufällig u unterschiedliche

diskrete Werte an, wobei die einzelnen Werte mit dem Index k bezeichnet

werden sollen, also k=1...u. (siehe Abb. 1).

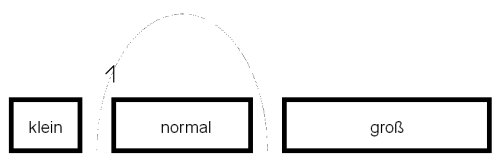

Die Aufgabe besteht darin, daß diese

Barriere vom "Springer" korrekt (d.h. mit einem Sprung,

der nicht zu kurz und nicht zu lang ist) übersprungen werden

soll. In Abbildung 2 sind mehrere Flugbahnen des Springers eingezeichnet.

Nur ein "korrekter" Sprung (durchgezogene Linie) gilt

als erfolgreich, zu lange oder zu kurze Sprünge (gestrichelte

Linien) werden als Mißerfolg gewertet. Die Schwierigkeit

dabei ist, daß der Springer blind ist, d.h. die Breite des

Hindernisses nicht selbst feststellen kann. Er ist auf Hilfe angewiesen.

Sie kommt vom "Sprecher", der die jeweilige Breite des

Hindernisses feststellen kann. Der Sprecher hat die Möglichkeit,

Laute auszustoßen, die der Springer hören und als Grundlage

für die Wahl seines Verhaltens nützen kann.

Der "blinde Springer" hat folgende Fähigkeiten:

1. Er kann "springen" (und zwar mit t vorher festliegenden Sprunglängen), aber nicht sprechen

2. Er kann "hören" (und zwar die s Sprachlaute des Sprechers), aber nicht sehen

3. Er kann das Gehörte mit bestimmter Wahrscheinlichkeit mit seiner "Entscheidung", wie weit er springt, verknüpfen.

4. Er kann den Erfolg oder Mißerfolg

seines Sprunges feststellen. Erfolg erhöht die entsprechende

Verknüpfungswahrscheinlichkeit zwischen gehörtem Laut

und seiner Sprungweite, Mißerfolg reduziert sie.

Die Beschreibung des Zusammenhangs zwischen

Hören und Springen erfolgt mittels einer Wahrscheinlichkeitsmatrix

H. Sie ist eine Markoff-Matrix mit den Zeilensummen 1,

also H1 = 1, die aus s Zeilen und t Spalten besteht.

Ihre Elemente h(i,j), i=1...s, j=1...t, haben anfänglich

alle die gleichen Werte: h(i,j) = 1/t.

Der Sprecher besitzt folgende Eigenschaften:

1. Er kann "sprechen", d.h. u unterscheidbare Laute ausstoßen, aber nicht springen

2. Er kann das Hindernis "sehen", die Breite der Barriere feststellen, aber nicht hören

3. Er kann die wahrgenommene Breite der Barriere mit bestimmter Wahrscheinlichkeit mit bestimmten Sprachlauten verknüpfen.

4. Er kann den Erfolg oder Mißerfolg

des Sprunges feststellen. Erfolg erhöht die entsprechende

Verknüpfungswahrscheinlichkeit zwischen wahrgenommener Barrierenbreite

und geäußertem Laut, Mißerfolg reduziert sie.

Die Beschreibung des Zusammenhangs erfolgt

mittels einer Wahrscheinlichkeitsmatrix G, einer Markoff-Matrix

mit den Zeilensummen 1, also G1 = 1, die aus u Zeilen

und s Spalten besteht. Die Elemente g(k,i), k=1...u, i=1...s,

haben anfänglich alle die gleichen Werte: g(k,i) = 1/s.

Der blinde Springer agiert in Welt A, seine

Hörfähigkeit ist er eine Schnittstelle zu Welt B. Der

Sprecher agiert in Welt B, durch seine Beobachterrolle besitzt

er eine Schnittstelle zu Welt A.

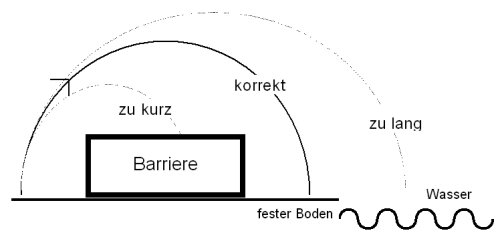

Einen Überblick über die Programmstruktur

bietet Abb. 3. In der Mitte der Abbildung ist die Barriere angedeutet.

Ein Zufallsgenerator wählt eine bestimmte Breite aus einer

Reihe von Möglichkeiten. Der senkrechte Doppelpfeil symbolisiert

die Variabilität der Barriere. Rechts von der Barriere ist

die Sprecher-Matrix in Form eines Rechtecks dargestellt. Das Rechteck

soll die Übergangsmatrix verkörpern, die eine spezielle

beobachtete Breite des Hindernisses (Zeileninput) mit einem Laut

verknüpft, der zufällig ausgewählt wird (Spaltenoutput,

als variabel dargestellt durch den waagrechten Doppelpfeil). Der

blinde Springer (Rechteck auf der linken Seite der Graphik) "hört"

den Laut (Zeileninput von H) und verknüpft ihn zufällig

mit einer Sprungweite (Spaltenoutput von H). In Abb. 3

ist die Matrix H gestürzt dargestellt (Spalten und

Zeilen vertauscht gegenüber der traditionellen Konvention,

daß die Zeilen horizontal verlaufen).

Die Schwierigkeit besteht darin, daß

der Beobachter zwar etwas sagen kann, aber die Bedeutung des Gesagten

anfänglich noch nicht festliegt. Er "stammelt"

also zunächst nur einen Laut. Der Springer kann den Laut

hören und dann springen, und zwar entweder kürzer, oder

länger als die Barriere, oder korrekt. Ein Vergleich zwischen

Barrierenbreite und tatsächlichem Sprung wird als Erfolg

bzw. Mißerfolg verbucht (siehe auch Abb. 2). Das korrekte

Springen bedeutet Erfolg, das nichtkorrekte einen Mißerfolg.

Erfolg bzw. Mißerfolg verändern die Kopplungswahrscheinlichkeiten

der Übergangsmatrizen bei Sprecher und Springer.

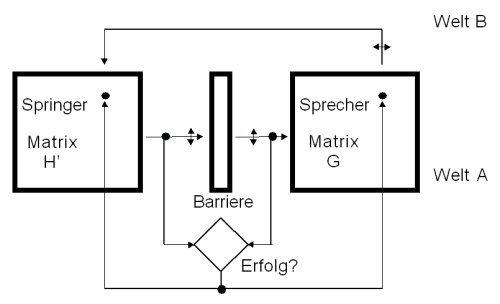

Die Realisierung des Simulationsmodells

Das Programm wurde mit einer graphischen Oberfläche

versehen (siehe Abb. 4), auf der sich Sprecher und Springer befinden.

Der Springer setzt mit einer Wurfparabel über die Barriere

hinweg, bzw. er springt zu weit (ins Wasser) oder zu kurz (auf

die Spitzen der Barriere).

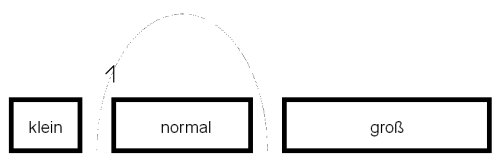

Für die Barrierenbreiten wählten

wir u = 3, die möglichen Breiten werden mit KLEIN, NORMAL

und GROSS bezeichnet. Die Sprungweite des Springers umfaßt

t = 4 Möglichkeiten, ZUKURZ, KURZ, MITTEL und LANG. u und

t sind nicht unbedingt gleich. t ist in unserem Beispiel um 1

größer als u, da der Springer nach unseren Annahmen

auch noch kürzer als die kürzeste mögliche Barriere

springen kann. Die s = 3 Sprachlaute symbolisierten wir mit A,

B und C, obwohl die Wahl der Laute völlig beliebig ist.

Formal läßt sich der Ablauf der

Simulation wie folgt darstellen:

Ein Zufallsgenerator bestimmt zunächst

die Barrierenbreite k*, die der Sprecher feststellt (z.B. k* =

2; NORMAL). Zur Bestimmung des Sprachlauts zieht ein zweiter Zufallsgenerator

eine Zahl y*, 0 ² y* < 1, die zunächst einer Gleichverteilung

entnommen wird, da die g(k,i) noch alle gleich groß sind.

Das zu y* gehörige i*, das den Sprachlaut festlegt, wird

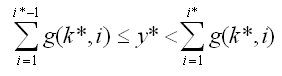

aus folgender Beziehung bestimmt:

Für diese und die nächste Formel

soll folgende Konvention gelten: Ist der letzte Wert des Laufindex

der Summation kleiner als der erste, also z.B. 0 (der letzte Wert)

< 1 (der erste Wert), so wird gar keine Summation durchgeführt.

Das Ergebnis der linken Seite wäre in diesem Fall 0. Ferner

soll für i* = s bzw. für j* = t auf der rechten Seite

das "kleiner gleich" Zeichen anstelle des "kleiner"

Zeichens stehen. Z.B. sei y*=0.13426556, damit wird i* = 1, als

Sprachlaut also "A" ausgewählt. Der Sprecher sagt

"A" zum Springer.

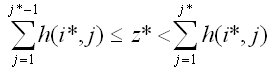

Beim Springer spielt sich ein analoger Vorgang

ab. Er "wählt" auf Basis einer gleichverteilten

Zufallszahl z* unter der Bedingung des gehörten Sprachlauts

(im Beispiel: i*=1; Sprachlaut "A") seine Sprungweite

j* aufgrund der Beziehung

Z.B. sei z*=0,936274, damit wird j* = 4, als

Sprungweite also "LANG" ausgewählt. Der Springer

springt, aber zu weit, daher, wie beide feststellen, ein Mißerfolg.

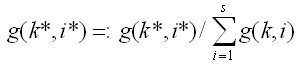

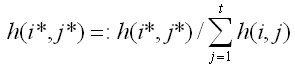

Nun wird gelernt, d.h., die Wahrscheinlichkeiten

g und h werden verändert. Da ein Mißerfolg vorliegt,

wird

gesetzt, ebenso

Faktorg und Faktorh sind die Lernparameter,

Faktorg > 1 und Faktorh > 1. In unserem Beispiel wählten

wir Faktorg = Faktorh = 2, also

gesetzt, ebenso

Alle anderen Elemente der Markoff-Matrizen

bleiben unverändert.

Im Falle eines Erfolgs wären die Wahrscheinlichkeiten

vergrößert worden:

und

Nun ist aber die Zeilensummenbedingung der

Markoff-Matrix verletzt. Eine Normierung auf Zeilensumme = 1 behebt

dieses Problem. Es gilt also zusätzlich

und

und

Das Ergebnis

Wenn in einer Iteration der Simulation ein

korrekter (nicht korrekter) Sprung erfolgte, werden die dazugehörigen

Elemente der beiden Markoff-Matrizen (also je eines pro Matrix)

vergrößert (verkleinert), alle anderen wegen der Normierungserfordernis

verkleinert (vergrößert). Die so entstandenen Zeilenmaxima

bzw. -minima können während der Anfangsphase eines Simulationslaufes

durchaus noch ihren Platz ändern. Nach einigen -zig Versuchen

"lernt" der Springer jedoch, auf den speziellen Zuruf

des Sprechers korrekt zu springen, der Sprecher "lernt",

die jeweilige Barrierenbreite mit einem jeweils dazugehörigen

Sprachlaut zu bezeichnen, der sich im Lauf der Zeit nicht mehr

ändert. Die entsprechenden Wahrscheinlichkeiten konvergieren

gegen 1 (bzw. 0). Die anfänglich flexible "Wortwahl"

ist starr und irreversibel geworden. Die Worte besitzen eine für

die weitere Simulation unveränderliche Bedeutung.

Bei einer Wiederholung des Experiments können

sich unterschiedliche Bezeichnungen für eine bestimmte

Barrierenbreite herausbilden, z.B. könnte im ersten Fall

"KLEIN" mit "A" bezeichnet worden sein, in

der Wiederholung könnte "KLEIN" mit "C"

benannt werden. Die Semantik der Sprachlaute ist also arbiträr

wählbar (zufällig) geworden, aber einmal festgelegt,

gibt es innerhalb eines Durchlaufs ab einer bestimmten Anzahl

von Sprüngen nur noch äußerst selten (mit vernachlässigbarer

Wahrscheinlichkeit) eine Änderung.

Es ist interessant, daß sich während

eines Durchlaufs Situationen einstellen, die Äquivokationen

(gleicher Name für verschiedene Objekte) gleichen. So konkurrieren

z.B. die Barrierenbreiten "KLEIN" und "NORMAL"

durch längere Zeit hindurch um die Bezeichnung durch den

Buchstaben "B". "B" bedeutet für den

Springer, daß er mit etwa gleicher Wahrscheinlichkeit "KURZ"

oder auch "MITTEL" springen soll. Nach längerer

Laufzeit stellt sich jedoch die Eindeutigkeit her, indem ev. "KLEIN"

mit einer Wahrscheinlichkeit von 1 "B" als Bedeutung

zugeordnet erhält, "B" bedeutet dann also "KLEIN",

"C" (oder "A") heißt dann etwa für

den Springer, er solle eine Sprungweite von "MITTEL"

(oder "LANG") wählen.

Auch das Umgekehrte zur Äquivokation

kann auftreten, nämlich zwei unterschiedliche Bezeichnungen

für dasselbe Objekt. In unserem Fall könnte die Barrierenbreite

"KLEIN" mit gleicher Wahrscheinlichkeit durch die Laute

"B" und "C" bezeichnet werden.

Die Sprungweite "ZUKURZ" (ihr entspricht

kein Zuruf durch den Sprecher) wird durch die Normierungsvorgänge

letztlich auf eine vernachlässigbar kleine Wahrscheinlichkeit

eingeschränkt. Der Springt springt dann so gut wie nie mehr

zu kurz.

Was sich in diesem Computerexperiment zeigt,

ist einerseits die Anpassung des Informationsapparates

an eine in bestimmter Weise wahrgenommene und erfahrene Umwelt,

andererseits stellt sich durch die zunächst zufällige

Kommunikation von Springer und Sprecher eine zuverlässige

Vereinbarung über die Bedeutung der in der Kommunikation

verwendeten Symbole her. In Welt B wird nach einer bestimmten

Lernzeit eine sprachliche Konstruktion von Welt A hergestellt,

d.h. es werden die als erfolgreich wahrgenommenen Zusammenhänge

von Welt A in Welt B übernommen. Zu Anfang der Simulation

gibt es eine Freiheit in der Zuordnung, die in Welt A, beschrieben

im klassischen physikalischen Bild, nicht vorkommt. Später

verliert sich die Zufälligkeit. Eindeutigkeit stellt sich

ein, und damit auch eine immer erfolgreichere Kooperation.

Es scheint erwähnenswert, daß sich

bei einer größeren Anzahl von möglichen Lauten

(Spalten der Sprechermatrix) oder möglichen Beobachtungen

(Zeilen der Sprechermatrix) als der Zahl angenommener Hindernisbreiten

dennoch Konvergenz gegen Wahrscheinlichkeit 1 einstellt, was bedeutet,

daß alle anderen Wahrscheinlichkeiten in der gleichen Zeile

gegen Null gehen. Dadurch "wählt" das System sozusagen

so viele Laute aus wie unterschiedliche Barrierebreiten auftreten.

Es beschränkt sein Repertoire auf das zur hinreichend differenzierten

Unterscheidung Notwendige.

Jenseits des chinesischen Zimmers

Der "blinde Springer" ist ein Beispiel

eines Programms, das in seinen Möglichkeiten über das

"Chinesische Zimmer" von Searle hinausweist. Man könnte

die beiden Simulationsmodelle in Gedanken vergleichbar machen,

indem man die chinesischen Fragekarten mit den Barrierebreiten

und die chinesischen Antwortkärtchen mit den Sprunglängen

identifiziert. Die Instruktionen stellen die Brücke zwischen

den Fragen und den Antworten dar. Sind bei Searle die Instruktionen

für die Zuordnung von Frage- und Antwortkarten fix vorgegeben

(und das ist nur für eine eingeschränkte Zahl von Fragen

und Antworten realisierbar), so bilden sich beim "blinden

Springer" diese Zuordnungen durch die Feststellung von Erfolg

oder Irrtum in Interaktion zwischen Springer und Sprecher erst

"von selbst" und unvorhersagbar heraus.

In bezug auf das eingeschränkte Repertoire (die Menge der vorhandenen Karten und Instruktionen bei Searle entspricht der endlichen Menge von Lauten bzw. Sprungweiten und Barrierebreiten beim blinden Springer) weisen die beiden Modelle durchaus die gleiche Komplexität auf. In dieser Hinsicht werden die Möglichkeiten des chinesischen Zimmers durch den blinden Springer nicht überschritten.

Natürlich kann nur dadurch von Selbstorganisation

gesprochen werden, indem wir bestimmte Prozesse im Computer als

unvorhersagbar annehmen, allen voran die Erzeugung von Zufallszahlen.

Der Zufallsgenerator wird in unserem Zusammenhang als black

box angesehen, obwohl auch die Zufallszahlen auf der Ebene

des Maschinencodes durch einen bestimmten Algorithmus erzeugt

werden. Diese willkürliche Einschränkung der Sicht entspricht

der Annahme des Turing-Tests für die Interaktion des Menschen

mit einem Terminal. Auch dort wird das Terminal als eine black

box phantasiert, hinter dem sich entweder ein lebendiger Mensch

oder eine Maschine verbergen kann. Der menschliche Forschungsdrang

wird sozusagen künstlich gelähmt.

Ein Vergleich mit Steinbuchs "Lernmatrix"

Abschließend soll die "Lernmatrix"

von Steinbuch (1961a; 1961b) mit dem hier beschriebenen Modell

verglichen werden. Die Lernmatrix war ursprünglich als anorganische,

elektronische Realisierung des "bedingten Reflexes"

gedacht , der bei höheren Lebewesen vorkommt. Im Gegensatz

zu angeborenen Reflexen (z. B. der Sehnenreflex: Durch Beklopfen

der Achillessehne oder der Patellarsehne läßt sich

eine Einzelzuckung der zugehörigen Muskeln bewirken; oder

der Fußsohlenreflex: Bei mechanischer Einwirkung auf die

Haut der Fußsohle werden die Zehen bzw. der Vorderfuß

kontrahiert) bilden sich bedingte Reflexe erst durch bestimmte

spezielle Erfahrungen aus. Ein berühmtes erstes Beispiel

ist der Hundeversuch von Iwan Petrowitsch Pawlow (Medizinnobelpreis

1904), der um die Jahrhundertwende nachwies, daß die verstärkte

Magensaftabsonderung bei Hunden, die einen angeborenen Reflex

darstellt und bei Anwesenheit von Futter zustandekommt, sich auch

dann einstellt, wenn z.B. nur ein Glockenton ertönt, falls

dieser Ton vorher mehrmals gemeinsam mit dem Futter angeboten

worden war. Steinbuch sieht in bedingten Reflexen "Schaltungen,

deren Verknüpfungsgesetz sich in Abhängigkeit von der

Eingangsinformation ändert" (Steinbuch 1961a: 37). Seine

"Lernmatrix" würde eine derartige Schaltung darstellen,

in deren Lernphase sich ein innerer "Zuordner" herausbilde,

der in der "Kannphase" die von außen vorgegebene

Zuordnung zwischen Input und Output widerspiegeln würde.

Zur Charakterisierung des Vorhandenseins eines Zusammenhangs zwischen

Input und Output schlägt Steinbuch einen speziellen Indikator,

er nennt ihn "Indiz" s,

vor, "ein Maß dafür ..., mit welcher Wahrscheinlichkeit

man auf Grund der bisherigen Beobachtungen schließen kann,

daß e ein Kennzeichen für b ist." (Steinbuch 1961a:

38). e meint dabei ein (binäres) Eingangssignal, b seine

zugehörige Bedeutung bzw. den gewünschten Output. s

= 1 heißt dabei, daß e mit maximaler Wahrscheinlichkeit

ein Kennzeichen für b ist, während s

= 0 besagt, daß aus den bisher angebotenen Datenpaaren von

e und b keinerlei Zusammenhang erschlossen werden kann. s

= -1 heißt, daß der Zusammenhang von b mit der Negation

von e höchste Wahrscheinlichkeit besitzt. s

wird dabei nicht aus einer einzigen Beobachtung errechnet, sondern

es wird eine gewisse (vorgebbare) Anzahl von Beobachtungen abgewartet,

die alle bei der Berechnung von s

berücksichtigt werden.

Nun wollen wir die Lernmatrix mit unserem Modell

des blinden Springers vergleichen. Es ist evident, daß in

unserem Modell nicht eine, sondern zwei Matrizen vorliegen, die

der Lernmatrix ähnlich sind. s

spielt eine analoge Rolle wie unsere g(k,i) bzw. h(i,j), die das

Ergebnis der kumulierten Erfahrung mit der Außenwelt repräsentieren.

Da wir aber keine Binärsignale benützen, sondern Ereignisse

welcher Art auch immer, verbleiben wir im nichtnegativen Bereich

der üblichen Definition von Wahrscheinlichkeiten (für

eine Lernmatrix mit nichtbinären Signalen siehe Müller

1964). Eine Veränderung von g(k,i) bzw. h(i,j) erfolgt in

unserem Modell zunächst bei Erfolg bzw. Mißerfolg nur

punktuell, an einem einzelnen Element der Matrix, durch die Normierungsvorgänge

werden aber alle Wahrscheinlichkeiten in der selben Zeile verändert.

Dieser Effekt bleibt im Steinbuchschen Modell aus. Hier wird ausschließlich

ein Element am Kreuzungspunkt eines einzelnen Inputs und eines

Outputs berücksichtigt. Eine weitere Differenz besteht in

der Trennung der Lern- von der Kannphase bei Steinbuch, während

unser Modell diese Trennung nicht kennt, sondern in Ausübung

seiner Aktivitäten lernt. Bei Steinbuch erfolgt der Übergang

zwischen "unbelehrtem" und "gelehrtem" Zustand

abrupt, im Sinne einer Sprungfunktion, bei uns verläuft er

inkremental über unterschiedlich große Wahrscheinlichkeiten.

Der größte qualitative Unterschied

zum Modell von Steinbuch ist unseres Erachtens im Vorhandensein

von zwei Matrizen in unserem Modell zu sehen, wonach (analog zu

Niklas Luhmanns systemtheoretischer Begriff der "doppelten

Kontingenz") eine bewertete (es muß die Unterscheidbarkeit

von Erfolg und Irrtum möglich sein) Interaktion von Individuen

(Pragmatik) die Konstruktion (also einen Entwurf, nicht ein Abbild)

von Semantik ermöglicht.

Die Steinbuchsche Lernmatrix führt zu

eindeutigen Ergebnissen und läßt keinen Platz für

Freiheitsgrade, während unser Modell die Wahl der Symbolik

ermöglicht. Von der pragmatischen Ebene aus betrachtet lernen

beide Modelle. Während Steinbuchs Matrix direkt lernt, mit

von außen vorgegebener Zuordnung zwischen Input und Output,

bringt der "blinde Springer" mittels einer in Kooperation

mit dem Sprecher festgelegten "Sprache" das gleiche

Ergebnis, aber auf einem Umweg, indirekt, zustande. Die Sprache

wird erst in Ausübung gemeinsamer Praxis konstruiert.

Letztere Beschreibung kann u. E. bestimmte Aspekte der Kommunikation

höherer Lebewesen besser darstellen als ein rigider Determinismus.

Ein soziales System?

Mit einiger Übertreibung könnten

wir beim Modell des blinden Springers sogar von der Entstehung

eines "sozialen Systems" sprechen, wenn wir Luhmanns

Definition heranziehen, in der die "doppelte Kontingenz"

eine zentrale Rolle spielt. Diese doppelte Zufälligkeit wäre

durch die Wahrscheinlichkeitsannahmen bei Springer und Sprecher

gegeben. Luhmann gibt bei einiger Phantasie im klaren Soziologendeutsch

eine Beschreibung unseres Modells. Man muß nur Springer

und Sprecher als black box ansehen: "Die Grundsituation der

doppelten Kontingenz ist einfach: Zwei black boxes bekommen es,

aufgrund welcher Zufälle auch immer, miteinander zu tun...Der

Versuch, den anderen zu berechnen, würde zwangsläufig

scheitern. Mit dem Versuch, ihn aus seiner Umwelt heraus zu beeinflussen,

kann man Glück haben und Erfahrungen sammeln... Die schwarzen

Kästen erzeugen sozusagen Weißheit, wenn sie aufeinandertreffen,

jedenfalls ausreichende Transparenz für den Verkehr miteinander.

Sie erzeugen durch ihr bloßes Unterstellen Realitätsgewißheit,

weil dies Unterstellen zu einem Unterstellen des Unterstellens

beim alter Ego führt...sie lernen jeweils selbstreferentiell

in ihrer je eigenen Beobachterperspektive. Das, was sie beobachten,

können sie durch eigenes Handeln zu beeinflussen versuchen,

und am feedback können sie wiederum lernen. Auf diese Weise

kann eine emergente Ordnung zustandekommen, die bedingt ist durch

die Komplexität der sie ermöglichenden Systeme, die

aber nicht davon abhängt, daß diese Komplexität

auch berechnet, auch kontrolliert werden kann. Wir nennen diese

emergente Ordnung soziales System." (Luhmann 1988: 156-157).

Schlußbemerkung

Anhand des hier vorgestellten Modells des blinden

Springers, das die Sicht der "Körperbasierten (embodied

and behavior-based) Artificial Intelligence" (wobei wir die

"Leiblichkeit" aus Kosten- und Zeitgründen ebenfalls

simulieren), der "Emergent AI" und des Freudschen Analysesettings

nützt, kann ein gewisser heuristischer Wert für Untersuchungen

im Bereich der Informationswissenschaften vermutet werden, die

sich nicht bloß entweder an sprachlichen oder an physischen

Phänomenen orientieren, sondern von einer interaktiven Kombination

beider Welten ausgehen. Es liegen uns Hinweise vor, daß

dieser kombinierte Ansatz bei geeigneter Modifikation eventuell

auch in anderen wissenschaftlichen Disziplinen fruchtbar gemacht

werden könnte. Eine Möglichkeit der Modifikation könnte

darin bestehen, daß die beiden Matrizen direkt miteinander

gekoppelt werden, also der Ausgang der einen Matrix direkt als

Eingang der anderen Matrix fungiert. Damit würde eine Reduktion

auf die sprachliche Ebene vorgenommen. Notwendig ist zusätzlich

irgend eine Art eines Algorithmus, der die Verknüpfungswahrscheinlichkeiten

zwischen Input und Output zu verändern erlaubt. Im Modell

des blinden Springers wählten wir ein Erfolgskriterium, wobei

die Übergangswahrscheinlichkeiten also bei Erfolg erhöht,

bzw. bei Mißerfolg reduziert werden. Interessanterweise

kann eine Kopplung und Koordination der beiden "Individuen"

auch dann zustandekommen, wenn kein Kriterium des äußerren

Erfolgs vorliegt, sondern wenn die Erhöhung bzw. Reduzierung

der Wahrscheinlichkeiten zufällig erfolgen. Im Rahmen einer

Dissertation im Bereich der Ethologie.wurde dieser Weg bereits

erfolgreich beschritten. Die Wahrscheinlichkeiten wurden sozusagen

selbstreferentiell verändert, also immer dann, wenn der/die

andere einen Laut geäußert hat, wurde zunächst

zufällig ein Laut produziert, der aber nicht nach außen

weitergegeben (sozusagen nur "gedacht") wurde, sondern

nur die Spalte zu bezeichnen half, in der die Wahrscheinlichkeit

erhöht werden sollte. Danach wurde mit demselben Mechanismus

aus der neuen (normierten) Verteilung ein Laut gezogen, der zur

Kommunikation mit dem/der anderen eingesetzt wird. In diesem Fall

kommt also ein Verfahren zur Anwendung, das nicht von einer direkten

Erfolgsverstärkung ausgeht, sondern vom indirekten Nutzen

koordinierten Verhaltens.

Eine weitere Modifikation könnte in der

verschachtelten wiederholten Anwendung des gleichen Prinzips von

Springer und Sprecher zur Herausbildung hierarchischer Strukturen

bestehen, wobei bestimmte Konstanten des vorliegenden Modells

(z. B. die Zahl der verfügbaren Laute oder der Anzahl unterschiedlicher

Sprungweiten) einer emergenten Veränderung unterworfen werden.

Derartige Forschungsarbeit muß aber erst in Zukunft geleistet

werden.

Literatur

Luhmann, N., Soziale Syteme, Grundriß einer allgemeinen Theorie, Suhrkamp, Frankfurt am Main 1988

Müller, P., Lernmatrix für nichtbinäre Signale, in: Neuere Ergebnisse der Kybernetik, Oldenbourg, München, Wien 1964: 313-325

Prem, E., Körperbasierte Artificial Intelligence, Vortrag am Österreichischen Forschungsinstitut für Artificial Intelligence, am 17. Dezember 1996, Schottengasse 3, A-1010 Wien

Searle, J., The Myth of the Computer, in: New York Review of Books, 29. April 1982: 5

Searle, J., Is the Brain's Mind a Computer Program? in: Scientific American, January 1990: 26-31

Steinbuch, K., Die Lernmatrix, in: Kybernetik, Band 1, Heft 1, Jänner 1961a: 36-45

Steinbuch, K., Automat und Mensch - Über menschliche und künstliche Intelligenz, Springer, Berlin/Göttingen/Heidelberg 1961b: 153-176

Turing, A., Computing Machinery and Intelligence, in: Mind 59, 1950: 434-460

Turkle, S., Life on the Screen, Simon &

Schuster, New York etc. 1995